Hive作為構建在Hadoop之上的數據倉庫工具,以其類SQL查詢語言HiveQL和強大的大數據處理能力,成為數據工程師和分析師的重要工具。通過直觀的圖表,我們可以快速理解Hive的核心概念。

第一張圖:Hive的數據類型全景圖

Hive支持豐富的數據類型,主要分為兩大類:

- 原始數據類型:包括整數類型(TINYINT, SMALLINT, INT, BIGINT)、浮點類型(FLOAT, DOUBLE)、布爾類型(BOOLEAN)、字符串類型(STRING, VARCHAR, CHAR)以及時間戳類型(TIMESTAMP, DATE)。這些類型直接映射到Java中的數據類型,用于存儲基本數據值。

- 復雜數據類型:這是Hive處理半結構化數據的關鍵,包括數組(ARRAY)、映射(MAP)和結構體(STRUCT)。例如,ARRAY可用于存儲有序的同類型元素集合,MAP存儲鍵值對,而STRUCT則允許將多個不同類型的字段組合成一個單元。這些復雜類型使得Hive能夠靈活處理如JSON或XML等嵌套數據格式。

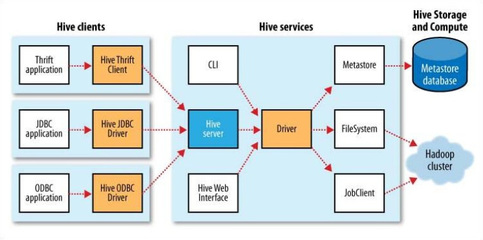

第二張圖:Hive的架構圖解析

Hive的架構體現了其作為“數據倉庫基礎設施”的角色,核心組件包括:

1. 用戶接口:CLI(命令行界面)、JDBC/ODBC驅動以及Web GUI(如Hue),為用戶提供多樣化的訪問方式。

2. 元數據存儲:通常使用關系型數據庫(如MySQL)存儲表結構、分區信息等元數據,這是Hive能夠以表形式組織HDFS數據的關鍵。

3. 驅動器:接收HiveQL查詢,經過編譯器生成執行計劃,由優化器優化后,通過執行引擎轉換為MapReduce、Tez或Spark作業。

4. 執行引擎:負責在Hadoop集群上調度和執行作業,默認使用MapReduce,但可配置為更高效的Tez或Spark。

5. Hadoop核心:數據實際存儲在HDFS中,作業由YARN進行資源管理和調度。

架構圖清晰地展示了查詢從提交到結果返回的流程:用戶通過接口提交HiveQL → 驅動器解析并訪問元數據 → 生成優化后的執行計劃 → 執行引擎調用計算框架 → 在HDFS上讀取/寫入數據 → 返回結果。

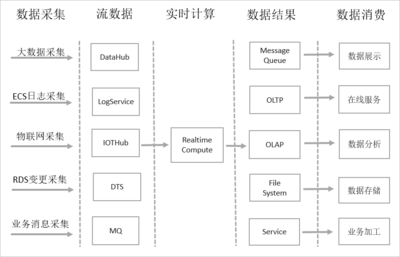

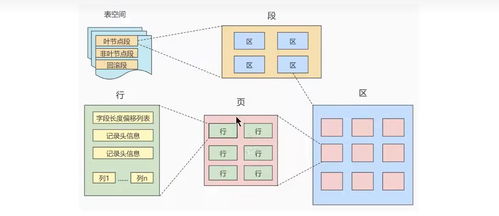

第三張圖:數據處理與存儲服務流程圖

這張圖展示了Hive如何整合數據處理和存儲服務:

- 數據存儲層:Hive本身不存儲數據,而是將數據以表的形式組織在HDFS中,支持文本文件、SequenceFile、ORC、Parquet等多種存儲格式。ORC和Parquet等列式存儲格式因其高壓縮比和查詢性能而廣泛應用。

- 數據處理流程:

- 數據加載:通過

LOAD DATA或INSERT語句將數據從HDFS或其他源導入Hive表。

- 數據轉換:利用HiveQL進行過濾、聚合、連接等操作,這些操作被轉換為分布式計算作業。

- 數據查詢:支持即席查詢和批處理,結果可寫回HDFS或導出到外部系統。

- 服務集成:Hive可與HBase、Kafka等系統集成,實現實時數據接入或聯合查詢。通過分區和分桶機制優化數據存儲,提升查詢效率。例如,按日期分區可以快速定位特定時間范圍的數據,而分桶則有助于數據采樣和連接操作優化。

Hive通過其數據類型系統處理多樣化數據,借助架構中的各組件協調工作,并依托Hadoop生態提供可靠的數據處理與存儲服務。這三張圖為我們勾勒出Hive的全貌:它不僅是查詢工具,更是連接用戶與海量數據之間的高效橋梁。對于大數據初學者,掌握這些核心圖表是深入理解Hive工作原理和實踐應用的重要第一步。